文/套路編輯部

來源:運營研究社(ID:U_quan)

“20多年來,互聯網以革命者的名義改變了我們很多的東西。但是同時在某種意義上,它也露出了它的另外一面。

比如說它壟斷的一面、拒絕開放的一面、攫取利潤的一面。所以你看互聯網長得并不像天使,它一半像天使、一半像魔鬼。”

在2021年創變者年會上,吳曉波發表了關于“變化”的主題演講,他稱互聯網既像天使、又像魔鬼。

的確,互聯網給我們帶來了意想不到的便利,足不出戶獲得新聞資訊,打開App就能享受到線下服務。個人的觀點、情緒,弱者的發聲、表達都可以在互聯網平臺上傳遞。

然而,色情、暴力、極端組織言論也在互聯網上有了出口,并加速了傳播,網絡監管的壓力也在逐漸變大。

于是,一個新的群體誕生了,他們從事著互聯網上“很臟的活”。

01

網絡清道夫

Facebook很初的理想是讓這個世界變成一個統 一的社區,打造一個“全球性社區,讓任何人都可以分享任何東西”。

多年來,扎克伯格堅持認為,Facebook既然只是個連接世界的平臺,本質上是家科技公司,就不該對在這個平臺上發布的內容負責。

近兩年,Facebook也因為這一理念帶來的后果飽受爭議,甚至被告上法庭。

在2021年12月,Facebook、Google、Twitter都對外宣稱,已經引入了事實核查,加大力度研發算法,同時聘請更多的專業人士加入。

但實際上,算法和專家背后,還有許多普通人在對抗著世界的陰暗面。

1)鑒黃師

去年,導演HansBlock和MoritzRiesewieck拍了一部紀錄片《TheCleaners》揭開了人工審核的遮羞布。

紀錄片以菲律賓的首都馬尼拉為背景,在馬尼拉市中心高檔的寫字樓隔間里,顯示屏上打出明晃晃的亮光,投射在內容審核員丹尼斯的臉上,各種生殖器的照片她已經見怪不怪了。

她要先學習英語里各種有關下半身的臟話、俚語,然后要對男女的人體構造研究透徹,對人類諸多的變態癖好吃個通透。

下了班,還得去趟成人用品店,熟悉熟悉很新 的成人用品,了解千奇百怪的硅膠玩具,來決定平臺上的這些圖片和視頻,是刪除,還是保留。

在普通人眼里,這似乎就是互聯網的“鑒黃師”,上班時間看著平時都難以搜索到的禁片,領著工資。

而實際上,多數內容審核員因為看了太多的成人圖片,已經嚴重影響到自己正常的性生活。

并且,“鑒黃師”也只是內容審核中較基礎的一項。

2)兒童內容審核

除了“色情”審核外,審核兒童相關內容的工作人員,需要承受更強烈的沖擊。

他們天天都會看到那些對孩子施虐、色情的照片、視頻,很小的孩子不過5歲。

在一些戰亂地區的視頻和圖片里,總會有手無寸鐵的孩子躺在地上,或者赤身裸體地奔跑。

審查員也不知道該選擇還原歷史真相,還是根據規定把這些過于裸露的圖片的刪除,一般來說,他們會選擇后者。

至于那些對孩子進行侵犯的內容,沒有工作人員愿意去看完,但審核工作要求必須完整瀏覽后給出評判。

當工作人員表示無法堅持看下去的時候,團隊負責人會勸說這是你的工作,要堅持下去,并且告訴她簽了合同。

這位姑娘在紀錄片的很后,放棄了這份工作,她寧可回到窮困的老家,和父母一起撿垃圾。

3)暴力、恐怖組織

更痛苦的,是審核極端恐怖主義內容審查員。

他們面對的是一段段從Facebook網絡端傳來的恐怖組織的處決視頻。

那些殺人的視頻,假如只是槍擊,算是輕松的。但這類內容里,更多的殺人手段,是斬首。

“被害人跪在鏡頭前,行刑者蒙著臉,對著鏡頭宣讀一通罪狀。在歡快的民族音樂里,行刑者掏出刀,對犯人進行斬首。”

假如斬首時用的是大砍刀,那就是刀起頭落。假如行刑者拿的是小匕首,斬首將是個漫長的過程。審查員已經可以通過傷口的平整度,判定暴徒用了什么刑具。

審核員說:這對每一個觀看者來說,都是一種酷刑。

02

誰在從事這份工作?

每一分鐘,YouTube有500小時的視頻,Facebook有250萬條信息,Twitter有45萬則推文在上傳。

在海洋般的信息流中,恐怖主義、虐殺、自殘、色情、極端組織言論、政治宣傳夾雜在網友的貓咪和美食照片里面,誰來負責清理這些垃圾信息?

1)勞動密集型產業

據不完全統計,各大科技公司的內容審核員工都來自第三世界國家或是不發達地區。其中,在菲律賓的外包內容審查員人數超過了10萬人。

YouTube、Google和Facebook等科技巨頭都會建立雙重審核制度,一是通過人工智能和算法進行首層審核,接著是通過建立在東南亞的外包公司來進行人工過濾。

作為一項龐大的勞動密集型產業,大多數人受到保密協定的約束,他們的工作直面互聯網的黑暗角落:過濾暴力、色情、恐怖內容,他們被稱為“網絡清道夫”。

在成為審查員之前,這些人需要經過三到五天的上崗培訓,培訓的內容,例如記住37個恐怖組織——他們的旗幟、制服、口號。

通過類似這樣的培訓,審查員上崗并化身成為道德天使,通過機械又辛勞的工作,使人們相信對社會的美好想象。

在培訓中,外包公司會告訴審核員們會看到什么,需要用到什么工具,以及會產生什么后果。

不少審核員會心生退意,這時候組長會對他們進行勸說,并且告知他們已經簽了保密協議。

保密協議中要求不能透露他們為誰而工作,假如違反了保密協議,他們就會失去工作并面臨10000美元的罰款,甚至牢獄之災。

并且,Facebook和Google并對外宣稱,他們沒有在馬尼拉的員工。事實上,馬尼拉的審核員的薪資也的確不來自Facebook或者Google,而是外包的公司。

2)內容審核員的獨白

內容審核員就像阻擊手,目標是那些違反了應用程式規定的用戶。

“我做了六年的內容審查員,天天必須瀏覽25000張圖片。”

在記錄片中,被采訪的審查員自述道,清理臟東西,是他們優選的職責,確保沒有任何可疑的內容上傳在平臺上。

他們同時也會對這份工作產生自豪感:“假如我們少工作一小時,那互聯網就會一團糟。”

Facebook在2021年的遭遇也印證了這句話:一名泰國男子放出了他殺害11個月大的女兒,然后自殺的視頻。

這段視頻引起了全世界的一片嘩然,并在社交網絡上保留了近24個小時,這讓Facebook成為眾矢之的。

所以,Facebook的內容治理員也從2021年的1萬人,增加到2021年的3萬人。

頭條也在去年提出強化總編輯責任制,不斷強化人工運營和審核,將現有6000人的運營審核隊伍,擴大到10000人,天津似乎也成了互聯網“審核之都”。

目前,新浪、頭條、網易、陌陌、豆瓣、搜狐等都在天津設立了審核專員職位,不少公

一的社區,打造一個“全球性社區,讓任何人都可以分享任何東西”。

多年來,扎克伯格堅持認為,Facebook既然只是個連接世界的平臺,本質上是家科技公司,就不該對在這個平臺上發布的內容負責。

近兩年,Facebook也因為這一理念帶來的后果飽受爭議,甚至被告上法庭。

在2021年12月,Facebook、Google、Twitter都對外宣稱,已經引入了事實核查,加大力度研發算法,同時聘請更多的專業人士加入。

但實際上,算法和專家背后,還有許多普通人在對抗著世界的陰暗面。

1)鑒黃師

去年,導演HansBlock和MoritzRiesewieck拍了一部紀錄片《TheCleaners》揭開了人工審核的遮羞布。

紀錄片以菲律賓的首都馬尼拉為背景,在馬尼拉市中心高檔的寫字樓隔間里,顯示屏上打出明晃晃的亮光,投射在內容審核員丹尼斯的臉上,各種生殖器的照片她已經見怪不怪了。

她要先學習英語里各種有關下半身的臟話、俚語,然后要對男女的人體構造研究透徹,對人類諸多的變態癖好吃個通透。

下了班,還得去趟成人用品店,熟悉熟悉很新 的成人用品,了解千奇百怪的硅膠玩具,來決定平臺上的這些圖片和視頻,是刪除,還是保留。

在普通人眼里,這似乎就是互聯網的“鑒黃師”,上班時間看著平時都難以搜索到的禁片,領著工資。

而實際上,多數內容審核員因為看了太多的成人圖片,已經嚴重影響到自己正常的性生活。

并且,“鑒黃師”也只是內容審核中較基礎的一項。

2)兒童內容審核

除了“色情”審核外,審核兒童相關內容的工作人員,需要承受更強烈的沖擊。

他們天天都會看到那些對孩子施虐、色情的照片、視頻,很小的孩子不過5歲。

在一些戰亂地區的視頻和圖片里,總會有手無寸鐵的孩子躺在地上,或者赤身裸體地奔跑。

審查員也不知道該選擇還原歷史真相,還是根據規定把這些過于裸露的圖片的刪除,一般來說,他們會選擇后者。

至于那些對孩子進行侵犯的內容,沒有工作人員愿意去看完,但審核工作要求必須完整瀏覽后給出評判。

當工作人員表示無法堅持看下去的時候,團隊負責人會勸說這是你的工作,要堅持下去,并且告訴她簽了合同。

這位姑娘在紀錄片的很后,放棄了這份工作,她寧可回到窮困的老家,和父母一起撿垃圾。

3)暴力、恐怖組織

更痛苦的,是審核極端恐怖主義內容審查員。

他們面對的是一段段從Facebook網絡端傳來的恐怖組織的處決視頻。

那些殺人的視頻,假如只是槍擊,算是輕松的。但這類內容里,更多的殺人手段,是斬首。

“被害人跪在鏡頭前,行刑者蒙著臉,對著鏡頭宣讀一通罪狀。在歡快的民族音樂里,行刑者掏出刀,對犯人進行斬首。”

假如斬首時用的是大砍刀,那就是刀起頭落。假如行刑者拿的是小匕首,斬首將是個漫長的過程。審查員已經可以通過傷口的平整度,判定暴徒用了什么刑具。

審核員說:這對每一個觀看者來說,都是一種酷刑。

02

誰在從事這份工作?

每一分鐘,YouTube有500小時的視頻,Facebook有250萬條信息,Twitter有45萬則推文在上傳。

在海洋般的信息流中,恐怖主義、虐殺、自殘、色情、極端組織言論、政治宣傳夾雜在網友的貓咪和美食照片里面,誰來負責清理這些垃圾信息?

1)勞動密集型產業

據不完全統計,各大科技公司的內容審核員工都來自第三世界國家或是不發達地區。其中,在菲律賓的外包內容審查員人數超過了10萬人。

YouTube、Google和Facebook等科技巨頭都會建立雙重審核制度,一是通過人工智能和算法進行首層審核,接著是通過建立在東南亞的外包公司來進行人工過濾。

作為一項龐大的勞動密集型產業,大多數人受到保密協定的約束,他們的工作直面互聯網的黑暗角落:過濾暴力、色情、恐怖內容,他們被稱為“網絡清道夫”。

在成為審查員之前,這些人需要經過三到五天的上崗培訓,培訓的內容,例如記住37個恐怖組織——他們的旗幟、制服、口號。

通過類似這樣的培訓,審查員上崗并化身成為道德天使,通過機械又辛勞的工作,使人們相信對社會的美好想象。

在培訓中,外包公司會告訴審核員們會看到什么,需要用到什么工具,以及會產生什么后果。

不少審核員會心生退意,這時候組長會對他們進行勸說,并且告知他們已經簽了保密協議。

保密協議中要求不能透露他們為誰而工作,假如違反了保密協議,他們就會失去工作并面臨10000美元的罰款,甚至牢獄之災。

并且,Facebook和Google并對外宣稱,他們沒有在馬尼拉的員工。事實上,馬尼拉的審核員的薪資也的確不來自Facebook或者Google,而是外包的公司。

2)內容審核員的獨白

內容審核員就像阻擊手,目標是那些違反了應用程式規定的用戶。

“我做了六年的內容審查員,天天必須瀏覽25000張圖片。”

在記錄片中,被采訪的審查員自述道,清理臟東西,是他們優選的職責,確保沒有任何可疑的內容上傳在平臺上。

他們同時也會對這份工作產生自豪感:“假如我們少工作一小時,那互聯網就會一團糟。”

Facebook在2021年的遭遇也印證了這句話:一名泰國男子放出了他殺害11個月大的女兒,然后自殺的視頻。

這段視頻引起了全世界的一片嘩然,并在社交網絡上保留了近24個小時,這讓Facebook成為眾矢之的。

所以,Facebook的內容治理員也從2021年的1萬人,增加到2021年的3萬人。

頭條也在去年提出強化總編輯責任制,不斷強化人工運營和審核,將現有6000人的運營審核隊伍,擴大到10000人,天津似乎也成了互聯網“審核之都”。

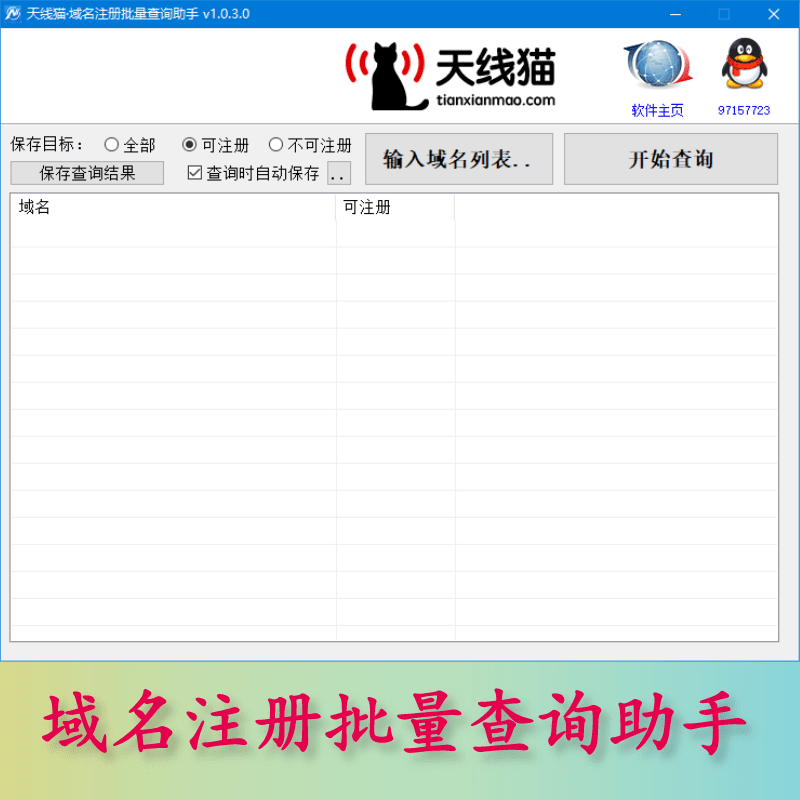

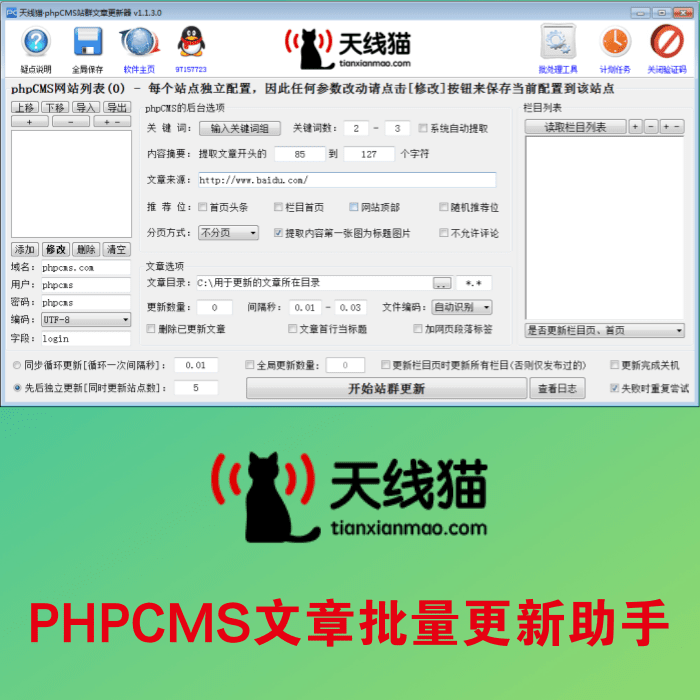

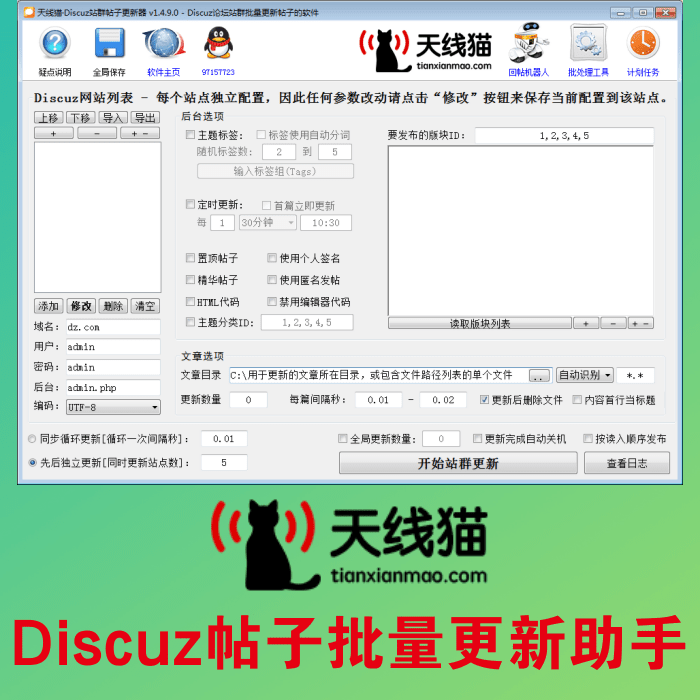

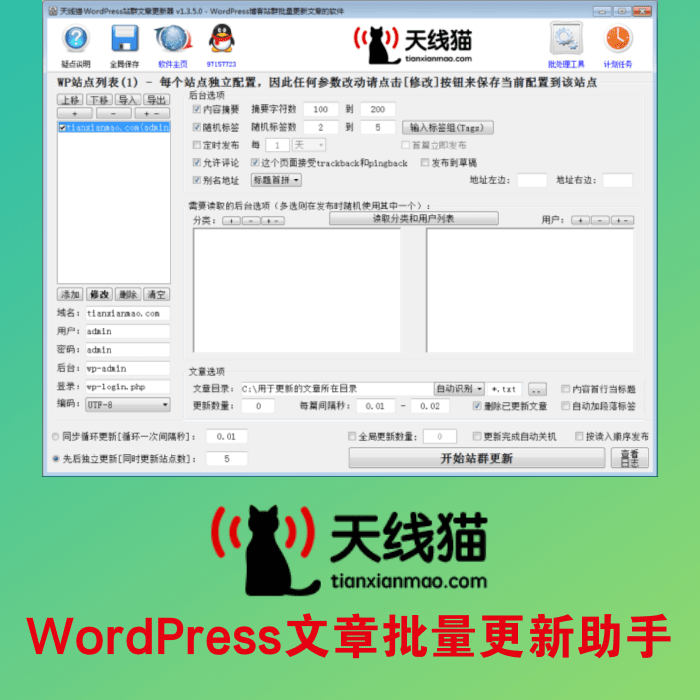

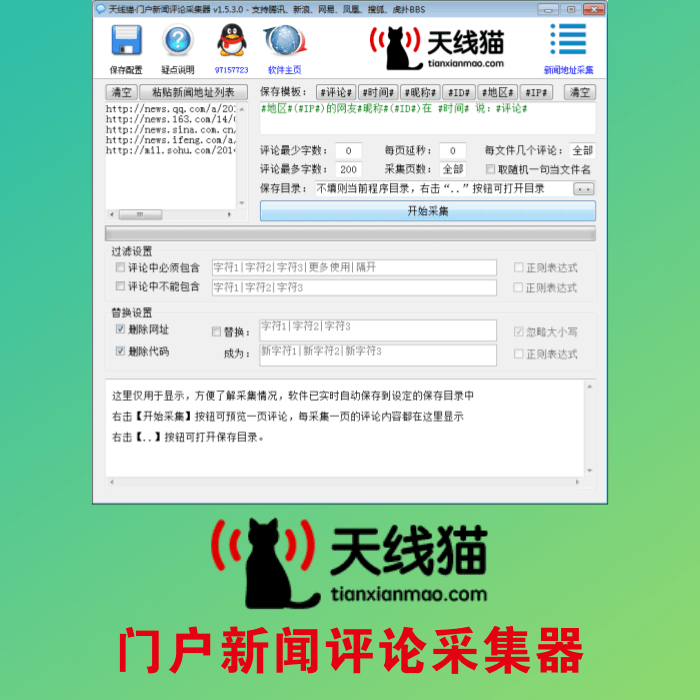

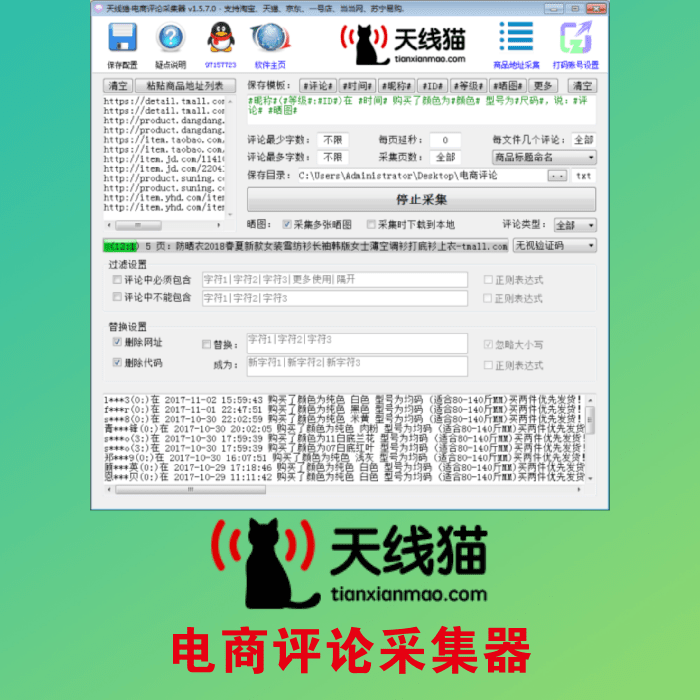

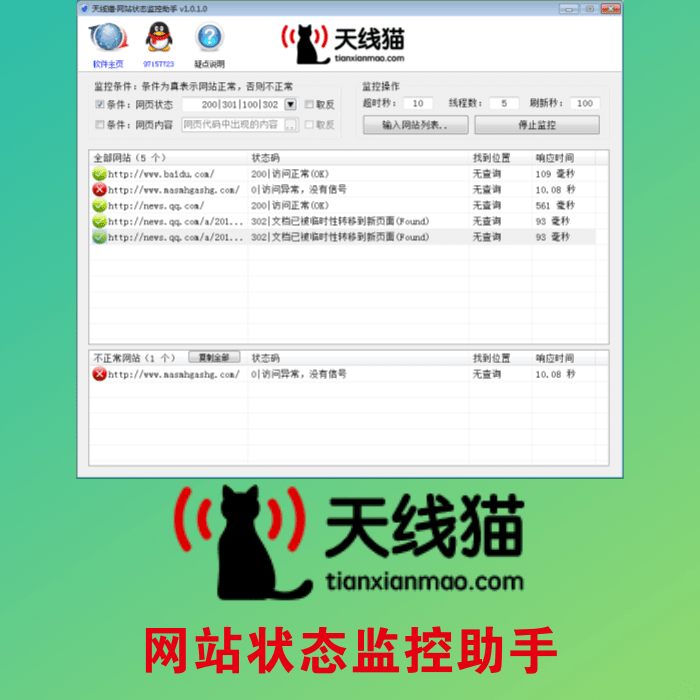

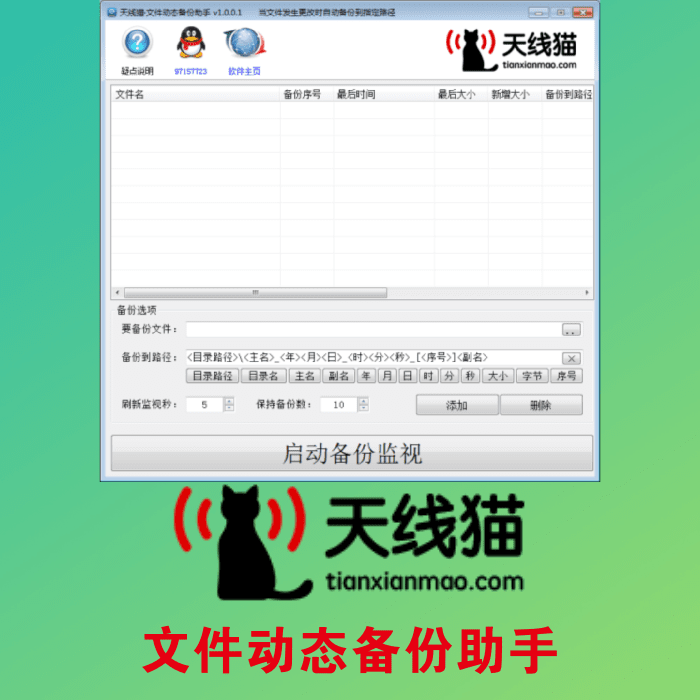

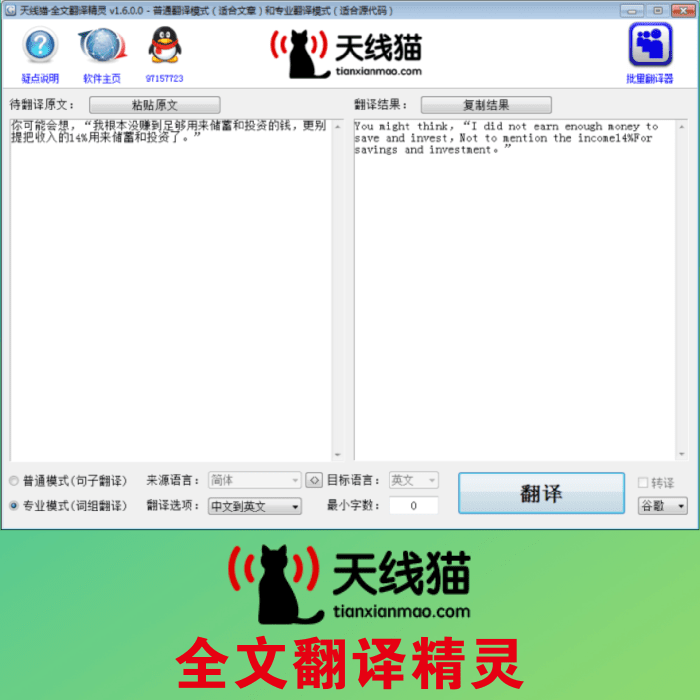

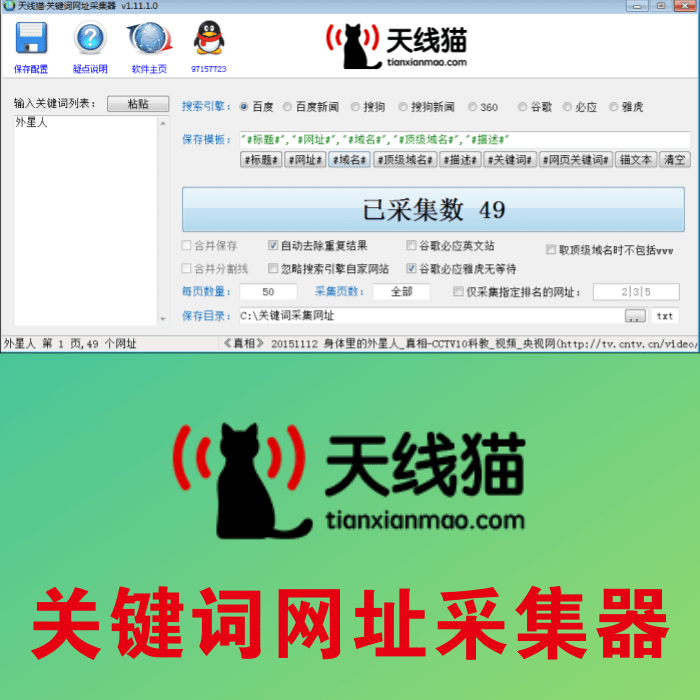

目前,新浪、頭條、網易、陌陌、豆瓣、搜狐等都在天津設立了審核專員職位,不少公 司在 和天線貓也有設立審核中心。

在招聘網站中,網絡信息審核員這一職位的平均工資在4-6千元左右。

相比我國,紀錄片中出現的審查員時薪僅有1美金。

美好愿景的話術,實際低廉的工資,同時還有心理問題的出現。

由于外包公司們未配有相應的心理咨詢師和審核員們天天看大量的暴力色情內容,他們的心理健康極易受到影響。

在審查員論壇上,還有更多駭人聽聞的視頻,包括虐待婦女、兒童和動物。有人表示他們每看幾個視頻就得休息一下才能緩過勁兒來。在日積月累的病態工作下,審查員們漸漸麻木,喪失了對人類的信心。

人就是機器,機器就是人。

“當我離開公司時,我已經三年沒有握手了,因為我發現人們很惡心。”

Bob說,

“世界上大多數正常人都他媽的是怪人。當我離開那里時,我對人性感到厭惡。我的很多同行也遭遇同樣的事情,我們都認為人性太可怕了。”

在紀錄片中,一位負責審查自我傷害的員工,在看過海量的自虐視頻后,不堪重負,在一個晚上選擇結束自己的生命。

03

為什么離不開人工審核?

回歸到內容審核本身,不少人都會質疑,為什么在技術如此發達的今天,還需要如此大量的人工審核。

1)算法誤判

頭條在去年3月份的時候出品了一個反低俗微信小程序“靈犬”,是國內首款反低俗信息小程序。

基于頭條反低俗算法模型,用戶只需輸入文字(10個字以上)或者圖片就可以檢測信息的健康程度,并給出結論此信息是否可以獲得推薦。

比如輸入“你餓不餓我下面給你吃”,輸出的健康指數為19%,被鑒定為“這里有問題”。

文字信息對機器來說還相對簡單,圖片和視頻在技術上會有更大難度。目前,“靈犬”小程序還不支持檢測視頻。

比如我用藝術作品“斷臂維納斯”的圖片檢測,機器通過識別圖中人物的皮膚裸露面積,就會認為是色情低俗的;而某些拍攝芭蕾舞的圖片,以機器的視角來看,會類似于裙底偷拍。

Facebook就曾經因為“裸露”,誤刪了一張聞名的越戰新聞照片,內容是一位小女孩遭到汽油彈炸傷、渾身赤裸奔跑,事件發生

司在 和天線貓也有設立審核中心。

在招聘網站中,網絡信息審核員這一職位的平均工資在4-6千元左右。

相比我國,紀錄片中出現的審查員時薪僅有1美金。

美好愿景的話術,實際低廉的工資,同時還有心理問題的出現。

由于外包公司們未配有相應的心理咨詢師和審核員們天天看大量的暴力色情內容,他們的心理健康極易受到影響。

在審查員論壇上,還有更多駭人聽聞的視頻,包括虐待婦女、兒童和動物。有人表示他們每看幾個視頻就得休息一下才能緩過勁兒來。在日積月累的病態工作下,審查員們漸漸麻木,喪失了對人類的信心。

人就是機器,機器就是人。

“當我離開公司時,我已經三年沒有握手了,因為我發現人們很惡心。”

Bob說,

“世界上大多數正常人都他媽的是怪人。當我離開那里時,我對人性感到厭惡。我的很多同行也遭遇同樣的事情,我們都認為人性太可怕了。”

在紀錄片中,一位負責審查自我傷害的員工,在看過海量的自虐視頻后,不堪重負,在一個晚上選擇結束自己的生命。

03

為什么離不開人工審核?

回歸到內容審核本身,不少人都會質疑,為什么在技術如此發達的今天,還需要如此大量的人工審核。

1)算法誤判

頭條在去年3月份的時候出品了一個反低俗微信小程序“靈犬”,是國內首款反低俗信息小程序。

基于頭條反低俗算法模型,用戶只需輸入文字(10個字以上)或者圖片就可以檢測信息的健康程度,并給出結論此信息是否可以獲得推薦。

比如輸入“你餓不餓我下面給你吃”,輸出的健康指數為19%,被鑒定為“這里有問題”。

文字信息對機器來說還相對簡單,圖片和視頻在技術上會有更大難度。目前,“靈犬”小程序還不支持檢測視頻。

比如我用藝術作品“斷臂維納斯”的圖片檢測,機器通過識別圖中人物的皮膚裸露面積,就會認為是色情低俗的;而某些拍攝芭蕾舞的圖片,以機器的視角來看,會類似于裙底偷拍。

Facebook就曾經因為“裸露”,誤刪了一張聞名的越戰新聞照片,內容是一位小女孩遭到汽油彈炸傷、渾身赤裸奔跑,事件發生 后引起了美國新聞界的巨大爭議。

2)內容難以界定

離不開人工的一個更重要原因是,涉及政治的內容機器難以直接處理,此類內容一旦出現問題將造成嚴重影響,必須交由人工進行審核判定。

甚至很多時候,人工也不知道是該還原真相,還是“凈化”網絡環境。

假如發生誤刪,也可能會引發霸凌,傷害一個或者更多的生命。

所以,在AI的背后還是近萬名審核團隊在輔助審核,去做算法無法做到的事情。

04

結語

在紀錄片中,被采訪的審查員冒著被罰款、牢獄之災的危險說到:

“我為什么愿意接受采訪,因為我們想要人們知道,我們的存在,有一群人在檢查社交媒體,我們正在盡很大努力,讓大家能安全使用這些社交平臺。”

寫這篇文章的原因,也是想讓大家知道,在科技的背后,還有他們的存在。

假如說互聯網的初衷是讓這個世界沒有信息的不平等,任何一個信息都可以無障礙地到達全世界的任何地方。

那不可避免地存在極端宗教主義、恐怖組織、負面的聲音。究竟人類的多樣性在哪里,人類對自我追求的沖突就會在哪里。

但至少,我們應該對他們致上很深的謝意。

后引起了美國新聞界的巨大爭議。

2)內容難以界定

離不開人工的一個更重要原因是,涉及政治的內容機器難以直接處理,此類內容一旦出現問題將造成嚴重影響,必須交由人工進行審核判定。

甚至很多時候,人工也不知道是該還原真相,還是“凈化”網絡環境。

假如發生誤刪,也可能會引發霸凌,傷害一個或者更多的生命。

所以,在AI的背后還是近萬名審核團隊在輔助審核,去做算法無法做到的事情。

04

結語

在紀錄片中,被采訪的審查員冒著被罰款、牢獄之災的危險說到:

“我為什么愿意接受采訪,因為我們想要人們知道,我們的存在,有一群人在檢查社交媒體,我們正在盡很大努力,讓大家能安全使用這些社交平臺。”

寫這篇文章的原因,也是想讓大家知道,在科技的背后,還有他們的存在。

假如說互聯網的初衷是讓這個世界沒有信息的不平等,任何一個信息都可以無障礙地到達全世界的任何地方。

那不可避免地存在極端宗教主義、恐怖組織、負面的聲音。究竟人類的多樣性在哪里,人類對自我追求的沖突就會在哪里。

但至少,我們應該對他們致上很深的謝意。

一的社區,打造一個“全球性社區,讓任何人都可以分享任何東西”。

多年來,扎克伯格堅持認為,Facebook既然只是個連接世界的平臺,本質上是家科技公司,就不該對在這個平臺上發布的內容負責。

近兩年,Facebook也因為這一理念帶來的后果飽受爭議,甚至被告上法庭。

在2021年12月,Facebook、Google、Twitter都對外宣稱,已經引入了事實核查,加大力度研發算法,同時聘請更多的專業人士加入。

但實際上,算法和專家背后,還有許多普通人在對抗著世界的陰暗面。

1)鑒黃師

去年,導演HansBlock和MoritzRiesewieck拍了一部紀錄片《TheCleaners》揭開了人工審核的遮羞布。

紀錄片以菲律賓的首都馬尼拉為背景,在馬尼拉市中心高檔的寫字樓隔間里,顯示屏上打出明晃晃的亮光,投射在內容審核員丹尼斯的臉上,各種生殖器的照片她已經見怪不怪了。

她要先學習英語里各種有關下半身的臟話、俚語,然后要對男女的人體構造研究透徹,對人類諸多的變態癖好吃個通透。

下了班,還得去趟成人用品店,熟悉熟悉很新 的成人用品,了解千奇百怪的硅膠玩具,來決定平臺上的這些圖片和視頻,是刪除,還是保留。

在普通人眼里,這似乎就是互聯網的“鑒黃師”,上班時間看著平時都難以搜索到的禁片,領著工資。

而實際上,多數內容審核員因為看了太多的成人圖片,已經嚴重影響到自己正常的性生活。

并且,“鑒黃師”也只是內容審核中較基礎的一項。

2)兒童內容審核

除了“色情”審核外,審核兒童相關內容的工作人員,需要承受更強烈的沖擊。

他們天天都會看到那些對孩子施虐、色情的照片、視頻,很小的孩子不過5歲。

在一些戰亂地區的視頻和圖片里,總會有手無寸鐵的孩子躺在地上,或者赤身裸體地奔跑。

審查員也不知道該選擇還原歷史真相,還是根據規定把這些過于裸露的圖片的刪除,一般來說,他們會選擇后者。

至于那些對孩子進行侵犯的內容,沒有工作人員愿意去看完,但審核工作要求必須完整瀏覽后給出評判。

當工作人員表示無法堅持看下去的時候,團隊負責人會勸說這是你的工作,要堅持下去,并且告訴她簽了合同。

這位姑娘在紀錄片的很后,放棄了這份工作,她寧可回到窮困的老家,和父母一起撿垃圾。

3)暴力、恐怖組織

更痛苦的,是審核極端恐怖主義內容審查員。

他們面對的是一段段從Facebook網絡端傳來的恐怖組織的處決視頻。

那些殺人的視頻,假如只是槍擊,算是輕松的。但這類內容里,更多的殺人手段,是斬首。

“被害人跪在鏡頭前,行刑者蒙著臉,對著鏡頭宣讀一通罪狀。在歡快的民族音樂里,行刑者掏出刀,對犯人進行斬首。”

假如斬首時用的是大砍刀,那就是刀起頭落。假如行刑者拿的是小匕首,斬首將是個漫長的過程。審查員已經可以通過傷口的平整度,判定暴徒用了什么刑具。

審核員說:這對每一個觀看者來說,都是一種酷刑。

02

誰在從事這份工作?

每一分鐘,YouTube有500小時的視頻,Facebook有250萬條信息,Twitter有45萬則推文在上傳。

在海洋般的信息流中,恐怖主義、虐殺、自殘、色情、極端組織言論、政治宣傳夾雜在網友的貓咪和美食照片里面,誰來負責清理這些垃圾信息?

1)勞動密集型產業

據不完全統計,各大科技公司的內容審核員工都來自第三世界國家或是不發達地區。其中,在菲律賓的外包內容審查員人數超過了10萬人。

YouTube、Google和Facebook等科技巨頭都會建立雙重審核制度,一是通過人工智能和算法進行首層審核,接著是通過建立在東南亞的外包公司來進行人工過濾。

作為一項龐大的勞動密集型產業,大多數人受到保密協定的約束,他們的工作直面互聯網的黑暗角落:過濾暴力、色情、恐怖內容,他們被稱為“網絡清道夫”。

在成為審查員之前,這些人需要經過三到五天的上崗培訓,培訓的內容,例如記住37個恐怖組織——他們的旗幟、制服、口號。

通過類似這樣的培訓,審查員上崗并化身成為道德天使,通過機械又辛勞的工作,使人們相信對社會的美好想象。

在培訓中,外包公司會告訴審核員們會看到什么,需要用到什么工具,以及會產生什么后果。

不少審核員會心生退意,這時候組長會對他們進行勸說,并且告知他們已經簽了保密協議。

保密協議中要求不能透露他們為誰而工作,假如違反了保密協議,他們就會失去工作并面臨10000美元的罰款,甚至牢獄之災。

并且,Facebook和Google并對外宣稱,他們沒有在馬尼拉的員工。事實上,馬尼拉的審核員的薪資也的確不來自Facebook或者Google,而是外包的公司。

2)內容審核員的獨白

內容審核員就像阻擊手,目標是那些違反了應用程式規定的用戶。

“我做了六年的內容審查員,天天必須瀏覽25000張圖片。”

在記錄片中,被采訪的審查員自述道,清理臟東西,是他們優選的職責,確保沒有任何可疑的內容上傳在平臺上。

他們同時也會對這份工作產生自豪感:“假如我們少工作一小時,那互聯網就會一團糟。”

Facebook在2021年的遭遇也印證了這句話:一名泰國男子放出了他殺害11個月大的女兒,然后自殺的視頻。

這段視頻引起了全世界的一片嘩然,并在社交網絡上保留了近24個小時,這讓Facebook成為眾矢之的。

所以,Facebook的內容治理員也從2021年的1萬人,增加到2021年的3萬人。

頭條也在去年提出強化總編輯責任制,不斷強化人工運營和審核,將現有6000人的運營審核隊伍,擴大到10000人,天津似乎也成了互聯網“審核之都”。

目前,新浪、頭條、網易、陌陌、豆瓣、搜狐等都在天津設立了審核專員職位,不少公

一的社區,打造一個“全球性社區,讓任何人都可以分享任何東西”。

多年來,扎克伯格堅持認為,Facebook既然只是個連接世界的平臺,本質上是家科技公司,就不該對在這個平臺上發布的內容負責。

近兩年,Facebook也因為這一理念帶來的后果飽受爭議,甚至被告上法庭。

在2021年12月,Facebook、Google、Twitter都對外宣稱,已經引入了事實核查,加大力度研發算法,同時聘請更多的專業人士加入。

但實際上,算法和專家背后,還有許多普通人在對抗著世界的陰暗面。

1)鑒黃師

去年,導演HansBlock和MoritzRiesewieck拍了一部紀錄片《TheCleaners》揭開了人工審核的遮羞布。

紀錄片以菲律賓的首都馬尼拉為背景,在馬尼拉市中心高檔的寫字樓隔間里,顯示屏上打出明晃晃的亮光,投射在內容審核員丹尼斯的臉上,各種生殖器的照片她已經見怪不怪了。

她要先學習英語里各種有關下半身的臟話、俚語,然后要對男女的人體構造研究透徹,對人類諸多的變態癖好吃個通透。

下了班,還得去趟成人用品店,熟悉熟悉很新 的成人用品,了解千奇百怪的硅膠玩具,來決定平臺上的這些圖片和視頻,是刪除,還是保留。

在普通人眼里,這似乎就是互聯網的“鑒黃師”,上班時間看著平時都難以搜索到的禁片,領著工資。

而實際上,多數內容審核員因為看了太多的成人圖片,已經嚴重影響到自己正常的性生活。

并且,“鑒黃師”也只是內容審核中較基礎的一項。

2)兒童內容審核

除了“色情”審核外,審核兒童相關內容的工作人員,需要承受更強烈的沖擊。

他們天天都會看到那些對孩子施虐、色情的照片、視頻,很小的孩子不過5歲。

在一些戰亂地區的視頻和圖片里,總會有手無寸鐵的孩子躺在地上,或者赤身裸體地奔跑。

審查員也不知道該選擇還原歷史真相,還是根據規定把這些過于裸露的圖片的刪除,一般來說,他們會選擇后者。

至于那些對孩子進行侵犯的內容,沒有工作人員愿意去看完,但審核工作要求必須完整瀏覽后給出評判。

當工作人員表示無法堅持看下去的時候,團隊負責人會勸說這是你的工作,要堅持下去,并且告訴她簽了合同。

這位姑娘在紀錄片的很后,放棄了這份工作,她寧可回到窮困的老家,和父母一起撿垃圾。

3)暴力、恐怖組織

更痛苦的,是審核極端恐怖主義內容審查員。

他們面對的是一段段從Facebook網絡端傳來的恐怖組織的處決視頻。

那些殺人的視頻,假如只是槍擊,算是輕松的。但這類內容里,更多的殺人手段,是斬首。

“被害人跪在鏡頭前,行刑者蒙著臉,對著鏡頭宣讀一通罪狀。在歡快的民族音樂里,行刑者掏出刀,對犯人進行斬首。”

假如斬首時用的是大砍刀,那就是刀起頭落。假如行刑者拿的是小匕首,斬首將是個漫長的過程。審查員已經可以通過傷口的平整度,判定暴徒用了什么刑具。

審核員說:這對每一個觀看者來說,都是一種酷刑。

02

誰在從事這份工作?

每一分鐘,YouTube有500小時的視頻,Facebook有250萬條信息,Twitter有45萬則推文在上傳。

在海洋般的信息流中,恐怖主義、虐殺、自殘、色情、極端組織言論、政治宣傳夾雜在網友的貓咪和美食照片里面,誰來負責清理這些垃圾信息?

1)勞動密集型產業

據不完全統計,各大科技公司的內容審核員工都來自第三世界國家或是不發達地區。其中,在菲律賓的外包內容審查員人數超過了10萬人。

YouTube、Google和Facebook等科技巨頭都會建立雙重審核制度,一是通過人工智能和算法進行首層審核,接著是通過建立在東南亞的外包公司來進行人工過濾。

作為一項龐大的勞動密集型產業,大多數人受到保密協定的約束,他們的工作直面互聯網的黑暗角落:過濾暴力、色情、恐怖內容,他們被稱為“網絡清道夫”。

在成為審查員之前,這些人需要經過三到五天的上崗培訓,培訓的內容,例如記住37個恐怖組織——他們的旗幟、制服、口號。

通過類似這樣的培訓,審查員上崗并化身成為道德天使,通過機械又辛勞的工作,使人們相信對社會的美好想象。

在培訓中,外包公司會告訴審核員們會看到什么,需要用到什么工具,以及會產生什么后果。

不少審核員會心生退意,這時候組長會對他們進行勸說,并且告知他們已經簽了保密協議。

保密協議中要求不能透露他們為誰而工作,假如違反了保密協議,他們就會失去工作并面臨10000美元的罰款,甚至牢獄之災。

并且,Facebook和Google并對外宣稱,他們沒有在馬尼拉的員工。事實上,馬尼拉的審核員的薪資也的確不來自Facebook或者Google,而是外包的公司。

2)內容審核員的獨白

內容審核員就像阻擊手,目標是那些違反了應用程式規定的用戶。

“我做了六年的內容審查員,天天必須瀏覽25000張圖片。”

在記錄片中,被采訪的審查員自述道,清理臟東西,是他們優選的職責,確保沒有任何可疑的內容上傳在平臺上。

他們同時也會對這份工作產生自豪感:“假如我們少工作一小時,那互聯網就會一團糟。”

Facebook在2021年的遭遇也印證了這句話:一名泰國男子放出了他殺害11個月大的女兒,然后自殺的視頻。

這段視頻引起了全世界的一片嘩然,并在社交網絡上保留了近24個小時,這讓Facebook成為眾矢之的。

所以,Facebook的內容治理員也從2021年的1萬人,增加到2021年的3萬人。

頭條也在去年提出強化總編輯責任制,不斷強化人工運營和審核,將現有6000人的運營審核隊伍,擴大到10000人,天津似乎也成了互聯網“審核之都”。

目前,新浪、頭條、網易、陌陌、豆瓣、搜狐等都在天津設立了審核專員職位,不少公 司在 和天線貓也有設立審核中心。

在招聘網站中,網絡信息審核員這一職位的平均工資在4-6千元左右。

相比我國,紀錄片中出現的審查員時薪僅有1美金。

美好愿景的話術,實際低廉的工資,同時還有心理問題的出現。

由于外包公司們未配有相應的心理咨詢師和審核員們天天看大量的暴力色情內容,他們的心理健康極易受到影響。

在審查員論壇上,還有更多駭人聽聞的視頻,包括虐待婦女、兒童和動物。有人表示他們每看幾個視頻就得休息一下才能緩過勁兒來。在日積月累的病態工作下,審查員們漸漸麻木,喪失了對人類的信心。

人就是機器,機器就是人。

“當我離開公司時,我已經三年沒有握手了,因為我發現人們很惡心。”

Bob說,

“世界上大多數正常人都他媽的是怪人。當我離開那里時,我對人性感到厭惡。我的很多同行也遭遇同樣的事情,我們都認為人性太可怕了。”

在紀錄片中,一位負責審查自我傷害的員工,在看過海量的自虐視頻后,不堪重負,在一個晚上選擇結束自己的生命。

03

為什么離不開人工審核?

回歸到內容審核本身,不少人都會質疑,為什么在技術如此發達的今天,還需要如此大量的人工審核。

1)算法誤判

頭條在去年3月份的時候出品了一個反低俗微信小程序“靈犬”,是國內首款反低俗信息小程序。

基于頭條反低俗算法模型,用戶只需輸入文字(10個字以上)或者圖片就可以檢測信息的健康程度,并給出結論此信息是否可以獲得推薦。

比如輸入“你餓不餓我下面給你吃”,輸出的健康指數為19%,被鑒定為“這里有問題”。

文字信息對機器來說還相對簡單,圖片和視頻在技術上會有更大難度。目前,“靈犬”小程序還不支持檢測視頻。

比如我用藝術作品“斷臂維納斯”的圖片檢測,機器通過識別圖中人物的皮膚裸露面積,就會認為是色情低俗的;而某些拍攝芭蕾舞的圖片,以機器的視角來看,會類似于裙底偷拍。

Facebook就曾經因為“裸露”,誤刪了一張聞名的越戰新聞照片,內容是一位小女孩遭到汽油彈炸傷、渾身赤裸奔跑,事件發生

司在 和天線貓也有設立審核中心。

在招聘網站中,網絡信息審核員這一職位的平均工資在4-6千元左右。

相比我國,紀錄片中出現的審查員時薪僅有1美金。

美好愿景的話術,實際低廉的工資,同時還有心理問題的出現。

由于外包公司們未配有相應的心理咨詢師和審核員們天天看大量的暴力色情內容,他們的心理健康極易受到影響。

在審查員論壇上,還有更多駭人聽聞的視頻,包括虐待婦女、兒童和動物。有人表示他們每看幾個視頻就得休息一下才能緩過勁兒來。在日積月累的病態工作下,審查員們漸漸麻木,喪失了對人類的信心。

人就是機器,機器就是人。

“當我離開公司時,我已經三年沒有握手了,因為我發現人們很惡心。”

Bob說,

“世界上大多數正常人都他媽的是怪人。當我離開那里時,我對人性感到厭惡。我的很多同行也遭遇同樣的事情,我們都認為人性太可怕了。”

在紀錄片中,一位負責審查自我傷害的員工,在看過海量的自虐視頻后,不堪重負,在一個晚上選擇結束自己的生命。

03

為什么離不開人工審核?

回歸到內容審核本身,不少人都會質疑,為什么在技術如此發達的今天,還需要如此大量的人工審核。

1)算法誤判

頭條在去年3月份的時候出品了一個反低俗微信小程序“靈犬”,是國內首款反低俗信息小程序。

基于頭條反低俗算法模型,用戶只需輸入文字(10個字以上)或者圖片就可以檢測信息的健康程度,并給出結論此信息是否可以獲得推薦。

比如輸入“你餓不餓我下面給你吃”,輸出的健康指數為19%,被鑒定為“這里有問題”。

文字信息對機器來說還相對簡單,圖片和視頻在技術上會有更大難度。目前,“靈犬”小程序還不支持檢測視頻。

比如我用藝術作品“斷臂維納斯”的圖片檢測,機器通過識別圖中人物的皮膚裸露面積,就會認為是色情低俗的;而某些拍攝芭蕾舞的圖片,以機器的視角來看,會類似于裙底偷拍。

Facebook就曾經因為“裸露”,誤刪了一張聞名的越戰新聞照片,內容是一位小女孩遭到汽油彈炸傷、渾身赤裸奔跑,事件發生 后引起了美國新聞界的巨大爭議。

2)內容難以界定

離不開人工的一個更重要原因是,涉及政治的內容機器難以直接處理,此類內容一旦出現問題將造成嚴重影響,必須交由人工進行審核判定。

甚至很多時候,人工也不知道是該還原真相,還是“凈化”網絡環境。

假如發生誤刪,也可能會引發霸凌,傷害一個或者更多的生命。

所以,在AI的背后還是近萬名審核團隊在輔助審核,去做算法無法做到的事情。

04

結語

在紀錄片中,被采訪的審查員冒著被罰款、牢獄之災的危險說到:

“我為什么愿意接受采訪,因為我們想要人們知道,我們的存在,有一群人在檢查社交媒體,我們正在盡很大努力,讓大家能安全使用這些社交平臺。”

寫這篇文章的原因,也是想讓大家知道,在科技的背后,還有他們的存在。

假如說互聯網的初衷是讓這個世界沒有信息的不平等,任何一個信息都可以無障礙地到達全世界的任何地方。

那不可避免地存在極端宗教主義、恐怖組織、負面的聲音。究竟人類的多樣性在哪里,人類對自我追求的沖突就會在哪里。

但至少,我們應該對他們致上很深的謝意。

后引起了美國新聞界的巨大爭議。

2)內容難以界定

離不開人工的一個更重要原因是,涉及政治的內容機器難以直接處理,此類內容一旦出現問題將造成嚴重影響,必須交由人工進行審核判定。

甚至很多時候,人工也不知道是該還原真相,還是“凈化”網絡環境。

假如發生誤刪,也可能會引發霸凌,傷害一個或者更多的生命。

所以,在AI的背后還是近萬名審核團隊在輔助審核,去做算法無法做到的事情。

04

結語

在紀錄片中,被采訪的審查員冒著被罰款、牢獄之災的危險說到:

“我為什么愿意接受采訪,因為我們想要人們知道,我們的存在,有一群人在檢查社交媒體,我們正在盡很大努力,讓大家能安全使用這些社交平臺。”

寫這篇文章的原因,也是想讓大家知道,在科技的背后,還有他們的存在。

假如說互聯網的初衷是讓這個世界沒有信息的不平等,任何一個信息都可以無障礙地到達全世界的任何地方。

那不可避免地存在極端宗教主義、恐怖組織、負面的聲音。究竟人類的多樣性在哪里,人類對自我追求的沖突就會在哪里。

但至少,我們應該對他們致上很深的謝意。

如果您覺得 互聯網很臟的活卻有幾十萬人在做 這篇文章對您有用,請分享給您的好友,謝謝

文章地址:http://www.brucezhang.com/article/online/5117.html

文章地址:http://www.brucezhang.com/article/online/5117.html